1. 简介 经济社会日益发展越来越多现代的都市区住宅区带来监控需求确保区内人们生活安全和文明 2. 系统运作原理 系统包含: 摄像机系统布置都市区各个重要地点 识别车牌的摄像机系统可以管控进出车辆情形 车辆速度警报系统 储存并分析资料的主机系统允许24/7录影并发现异常行为 显示器系统可以显示所有摄像机的设想资料 分机系统让您可以轻松地查询系统内的任何摄像机资料,载图,控制等操作 都市区内部所有电梯摄像头监视系统采用宽屏高清摄像机可以清楚的观察电梯进出人脸部和选按层别按钮 智能停车场与门禁卡系统连接管控. 图片:都市区监控中心 图片:摄像机载图清晰详细连续24小时 片:路图上流通车辆速度感应及警报系统 智能停车场监控

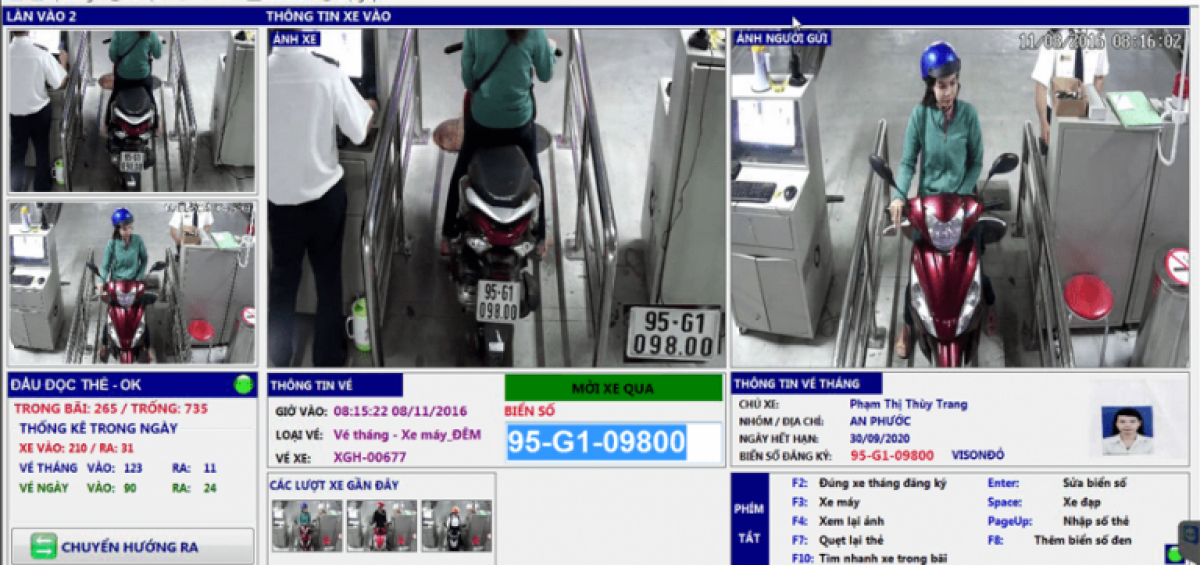

SPM智能停车场管理方案 智能停车场管理方案简介 SPM 为智能停车场管理措施目的为提高目前停车场的效率和可靠性。本方案采用磁卡、摄影机结合让您可以快速准确的记录并管控车辆出入的票号、车牌和驾驶人等资料。另外,此系统还可以提供软件工具让管理人能够轻松的掌握停车场运作情况的详细资料. 2. SPM系统运作原理 A. 系统包括: 拍照车牌的摄像机 拍照驾驶人的摄像机 读卡机 Barrier + Loop Detector (供选) DVR card (camera analog) 电脑(设置智能停车场管理软件) 打印机 UPS B. 运作原理 入口 入口保安刷卡后将卡片交给车子驾驶人,同时软件以text定样存下车牌和驾驶人的照以及卡片本身资料成为电子票存入电脑 出口 出口保安向车主取卡刷上读卡机后软件立即拍照车牌和驾驶人照片同时调出入口资料进行核对后若相符显示器会显示客户应付停车费金额。停车费可以采用及时收费或固定收费制定,该系统可以结合barier让控制车子进出 3. 突出特点 全部功能结合在一起 SPM 的设计符合越南机动车车牌特点可以识别所有车牌特点如:私人车(白色牌),军车(红色牌),公务车(蓝色车牌)以及其他特殊车如外交车,大使馆车,国际组织车等 准确、快速齐全的识别能力让客户快速轻便的停车和取车 识别时间< 100 mili 秒 准确度> 95% 清晰照片 识别车牌上所以记号 可于多种品牌的摄像机相容 使用高清IP camera -HD, FullHD 支援多种摄像机: Panasonic, Dmax, Sony, Axis, Dahua, Hikvision,Read more

1. 仓库监控管理系统简介 监控系统措施里面仓库监控管理系统确保安全要求比较特殊,特别是比较重要的行业如军队武器舱或大公司大集团的仓储。 该系统不仅提供摄像监视功能还需要有针对安全治安等危机提早警报功能并能设置从外往内多层次的保按系统。 2. 仓储监控系统原理图 本系统基本成分 a. 摄像系统 • 室外旋转摄像机 • 室外摄像枪 • 室内半球形摄像头或摄像枪 • 条件允许情况下可以加装热感应摄像机为仓储内夜晚更好监视效果 b. 感应系统 • 光纤感应以震动发现原理运作,感应器固定在铁网上或埋在地下,使用于围墙区 • 镭射感应器:采用室外镭射网于围墙区或仓储周围 • 窗户,仓储内专用感应器 c. 门禁系统 • 刷卡,指纹,面孔,眼纹门禁设备 • 金属扫射门禁行人管控 • 车牌监控 d. 中心监控系统 • 显示各个摄像机,感应器等监控设备的现场情况于屏幕 • 自动发现,警报异常行为 • 资料储存时间长(6个月到1年) • 分享监控权给其他单位 • 集中管理多仓储 图片:仓储管理系统监控中心显示屏幕 图片: 仓储外方及围墙监视系统监控屏幕 图片: 仓储内监视系统监控中心屏幕 采用监视系统监控使仓储管控更简易聪明顺畅。 LETO智能会针对不同客户仓库平面和具体情况提出最好的措施。

LETO智能股份有限公司成立于2010年,致力于成为越南专业化程度最高的智慧建筑系统综合集成商。凭借设计咨询、系统集成、安防智能设备供应及贴心的服务为智慧建筑,智能工厂,智能家居,智慧园区,酒店,办公等多领域提供创新的解决方案。 LETO智能股份有限公司成立于2010年,10年来公司专注于建筑智能化行业的精耕细作,始终以精益求精的高标准要求自己在技术上不断克难攻坚,在管理上追求效率和创新。从智慧建筑、智慧工厂到智慧园区,都取得了骄人的成绩。公司已逐步发展为越南专业技术能力最强,经营管理最规范,专业化程度最高的智能建筑系统综合集成商之一。 以”创造智慧生活”为口号,我们致力于打造高品质的项目,并始终关切客户需求,一切以围绕客户为中心来规划和设计;我们也秉持较真务实的态度,在实践中不断自我鞭策和改进,力求每天进步一点点,在数年如一日的坚持下,使得公司在市场上赢得了极佳的声誉。

LETO智能股份有限公司成立于2010年,致力于成为越南专业化程度最高的智慧建筑系统综合集成商。凭借设计咨询、系统集成、安防智能设备供应及贴心的服务为智慧建筑,智能工厂,智能家居,智慧园区,酒店,办公等多领域提供创新的解决方案。 LETO智能股份有限公司成立于2010年,10年来公司专注于建筑智能化行业的精耕细作,始终以精益求精的高标准要求自己在技术上不断克难攻坚,在管理上追求效率和创新。从智慧建筑、智慧工厂到智慧园区,都取得了骄人的成绩。公司已逐步发展为越南专业技术能力最强,经营管理最规范,专业化程度最高的智能建筑系统综合集成商之一。 以”创造智慧生活”为口号,我们致力于打造高品质的项目,并始终关切客户需求,一切以围绕客户为中心来规划和设计;我们也秉持较真务实的态度,在实践中不断自我鞭策和改进,力求每天进步一点点,在数年如一日的坚持下,使得公司在市场上赢得了极佳的声誉。